動画共有サイト「ニコニコ動画」が年に1度開催している大規模イベント「ニコニコ超会議2017」が、今年も4月29、30日の2日間にわたり、幕張メッセで開催された。同イベントは、毎回、趣向を凝らしたさまざまな企画や展示が行われ、2日間で約15万人を動員する。

その企画の1つとして上演されたのが、NTTの最新ICT技術を駆使して実現された「超歌舞伎 supported by NTT 花街詞合鏡(くるわことばあわせかがみ)」。昨年初めて上演された超歌舞伎「今昔饗宴千本桜」は、中村獅童氏をはじめとする歌舞伎俳優とバーチャルシンガーの初音ミクが共演する「まったく新しいかたちの歌舞伎」として、注目を浴びた。

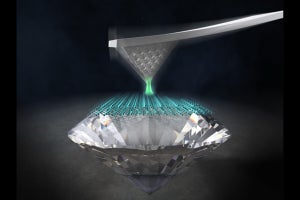

2回目となる今回は、昨年に引き続きNTTの研究所が開発したイマーシブテレプレゼンス技術「Kirari! 」が採用されており、前回よりも進化した映像・音声技術が随所に使用されていた。このKirari! とは、いかなる技術なのか。

|

|

|

メインキャストを務めた初音ミク(左)と中村獅童氏(右) |

リアルタイムで「分身」同士の立廻りを実現!

そもそもKirari! は、スポーツ中継において「あたかも競技場にいるかのような臨場感を実現する」というコンセプトで開発された技術である。

今回、超歌舞伎の演出で大きな役割を担っていたのがKirari! の被写体抽出技術だ。これは、映像のなかから特定の被写体をリアルタイムに分離・抽出するというもので、イメージとしてはグリーンバックを用いた背景合成に近い。これを単色ではなく、もっと複雑な背景でも実現しようとしているのがKirari! なのだ。

昨年の超歌舞伎では、この被写体抽出技術で中村獅童氏の姿を抽出し、何体もの「分身」をスクリーンに投影するという試みがなされ、話題を呼んだ。

今年はアルゴリズムがさらに高度化。中村獅童氏と澤村國矢氏の2人を同時に被写体抽出技術で抽出し、スクリーンに投影された分身同士がバーチャルで立ち廻りを見せるという演出で会場を沸かせた。

背景の複雑化を可能にしたのも進化のポイントだ。昨年は、Kirari! のためにステージ上に専用のブースと照明を設置。分身演出時には、役者がブース内にいなければならなかったのだが、今年はステージ上の場所さえ特定しておけば、専用ブースを使うことなくリアルタイムでの抽出が可能となった。

今後は野外など、より複雑な背景においてもリアルタイムに抽出することを目指しているという。