VOCALOIDの大ヒットも手伝って(?)か、再び脚光を集めている音声合成技術。大まかにいえば、与えられたテキストを解析し、それを各言語の音声データとして出力する、という2つを柱とする技術だ。テキスト・トゥー・スピーチ(TTS)とスピーチシンセサイザも同義語と言っていい。OS Xにも最初期のバージョンから搭載されているが、Lionでは日本語を含む22の言語に対応したことで注目されている。

ちなみに、パーソナルコンピュータの分野における日本語TTSは、古くはNECのPC-6001mk2(前モデルの6001でもオプション提供されていたが)のときに標準装備されていたし、旧Mac OSでもMac OS 8.5まで日本語対応のTTSが用意されていた。Macが日本語を発することそれ自体は、特に斬新な技術ではない。

注目されるべきは、その解析能力が一定レベルに達していることと、今秋リリースされるiOS 5との関連性だろう。

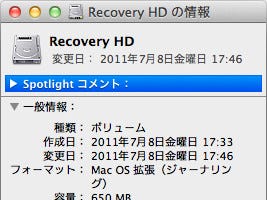

日本語を含む多言語対応のTTSエンジンは、/System/Library/Speech/Synthesizersディレクトリに「MultiLingual.SpeechSynthesizer」バンドルとして用意されている。このエンジンが、多言語対応TTSエンジンを初めて利用すると/System/Library/Speech/Voicesディレクトリへインストールされる各言語のデータ(*.SpeechVoice)を参照し、与えられたテキストを解析して、音声データとして出力する。

解析能力は、かな漢字混じりの日本語を"ある程度"読み上げられるレベルに達している。ニュースサイトにアクセスし、適当なテキストを選択したうえでoption-ESC(このショートカットキーを有効にするにはシステム環境設定の操作が必要)を押すと、少々イントネーションが怪しいことに目を瞑ればだが、女性の声で読み上げてくれる。文脈までは解さないようで、「人間」が「ひとあいだ」だったり、「栄光」が「さかえひかり」だったりもするが、大意をつかむことはできる。

iOS 5との関連性は、現段階では推測に過ぎないが、OS XとはOSのコアコンポーネントに共通項が多いだけに、iOS 5に搭載されても不思議はない。すでに基本的な音声認識技術が導入済なことを考慮すると、人間との"会話"がユーザインターフェイスの方向性としてあるのではないか。この点に関しては、iOS 5以降のOS――OS Xを含む――に期待していいと考えている。