生成AIはその構造上、プロンプトにまったく同じ入力を行っても毎回違う結果が出力される。具体的にどのような経緯でそうなっているのかをユーザーが知る方法はないが、ベースとなっている大規模言語モデル(LLM: Large Language Model)がそういった仕組みになっている。これはこの技術の特徴的な動作だ。今回はロゴの生成を通じてこの特性を体感してみよう。

連載「Copilot in Windowsを使ってみよう」のこれまでの回はこちらを参照。

同じプロンプトでも異なる返答、それが生成AI

生成AIはその構造上、プロンプトに同じ指示を行っても毎回異なる出力が行われる。自然言語で質問を行った場合には返ってくる返答の結論にはそれほど違いはないかもれないが、説明の仕方や言い回しなどがその都度違ったものになる。

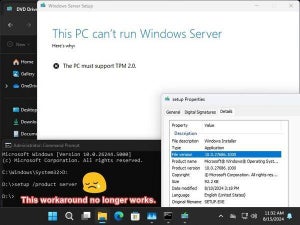

これに対して従来の専門家システムは決定論的な構造になっており、同じ質問を行った場合には基本的に同じ回答が得られる。これが従来の決定論的なシステムと生成AIの大きな違いと言える。

この違いは画像生成などについて特にその違いが分かりやすい。前回のロゴ生成の話をベースに、さらにこの非決定論的な動きを体感してみよう。

同じ質問で生成されるロゴはどう変わるか

前回は次の質問をプロンプトに対して入力してロゴの生成を行った。