楽天グループは12月18日、日本語に特化した新たな大規模言語モデル(LLM)と、同社初の小規模言語モデル(SLM)の2つのAIモデルを発表した。両モデルは、来春を目途にオープンソースコミュニティに向けて公開される予定で、AIアプリケーションを開発する企業や技術者などの専門家を支援することを目指す。

-

楽天グループはAIモデルの開発を進め、自社サービスにもAIを組み込んでいる(写真は「Rakuten Optimism 2024」の基調講演に登壇した楽天グループ 代表取締役会長 兼 社長 三木谷浩史氏)

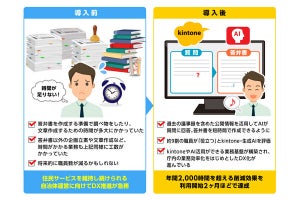

「Rakuten AI 2.0」は、2024年3月に公開した日本語に最適化した高性能なLLMの基盤モデル「Rakuten AI 7B」を基に開発し、8つの70億パラメータで構築した「エキスパート」と呼ばれるサブモデルで構成されている。8倍規模の高密度モデルに匹敵する性能を発揮するといい、消費計算量を4分の1程度に抑えることが可能だという。

「Rakuten AI 2.0 mini」は、15億パラメータの基盤モデル。小規模なモデルのためモバイル端末にも導入でき、データをリモートサーバに送信することなく自社運用することができるとのこと。大規模モデルと比べ、SLMはプライバシーの保護や低遅延、コスト効率が求められる特定のアプリケーションに適している。

楽天は最新のLLMおよびSLMをオープンなモデルとして提供することで、オープンソースコミュニティへの貢献を目指す。そして、自社で最新のLLMモデルの開発を継続することにより、知見やノウハウを蓄積し、「楽天エコシステム(経済圏)」の拡大に取り組んでいく。