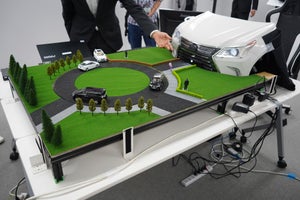

京セラは11月7日、自動運転車向けに光学カメラとLiDARの光軸を一致させて、1ユニットにまとめた「カメラ‐LiDARフュージョンセンサ」を開発したことを発表した。

自動運転においては、走行中に障害物を正確に検知することを目的に、長距離かつ精度の高い3D情報を瞬時に取得できるLiDARが用いられているが、一方で物体が何であるのかなどを認識するために光学カメラも用いられており、今後の自動運転の高度化の実現にはそれらを組み合わせて活用することが期待されている。しかし、別々のユニットとして利用する場合、車体の別々の場所に設置されるため、得られるデータに視差が生じ、センサ間のキャリブレーションが必要となり、遅延が生じるといった課題のほか、距離が離れている物体の認識の場合、その視差の影響から、それぞれのセンサが同じものを認識しているのかの保証が難しいといった課題を抱えているという。

同社はこうした問題を解決することを目的に、京セラグループが保有するセラミックパッケージと半導体技術を活用した独自MEMSミラーや、カメラで培った光学技術、携帯電話で培った回路・制御技術、複合機・プリンタで培った光走査技術などのコア技術を融合させる形で、2017年よりLiDARと光学カメラの一体化を目指した開発を推進してきた。

中でも、独自の光学設計技術を活用することで、光学カメラとLiDARという2つのセンサデバイスを1つのユニットにおさめ(処理を担うECUはそれぞれ別に存在するが、同一ユニット内に収まっている)、光軸を一致させることに成功。この結果、キャリブレーションが不要になるなど、それぞれの検知結果を統合させるプロセスが容易になり、リアルタイムに光学カメラで取得した画像データとLiDARの距離(点群)データを統合して、高度な物体認識を図ることを可能としたとする。