東京大学(東大)は5月14日、画像中の個人の特定などにつながるプライバシー関連の情報を秘匿しつつも、元の画像の見た目と内容の両方を維持する新たな加工手法として、生成AIを用いて、秘匿したい箇所だけを類似の生成画像に部分的に置き換える「生成的コンテンツ置換」(GCR)法を開発したと発表した。

同成果は、東大大学院 工学系研究科 電気系工学専攻の矢谷浩司准教授らの研究チームと、Microsoft Research Asia D-CORE Program、メルカリ R4D、インクルーシブ工学連携研究機構の共同研究チームによるもの。詳細は、現地時間5月16日までハワイ・ホノルルで開催中のヒューマン・コンピュータ・インタラクションに関する国際会議「CHI 2024」にて発表された。

現在、カメラ機能を搭載したスマートフォンやデジタルカメラが普及し、誰でも気軽に撮影でき、またSNSで画像や映像を公開することができる。しかし、被写体や風景の撮影と公開の許可さえあれば問題ないわけではなく、撮影者の意図しない、たまたま背景に写り込んだ人々や、車のナンバープレートといった個人の特定につながるような情報などについては、配慮されていないことが多い。その結果、写り込んだ人々が特定されたり、また撮影者自身の自宅の所在地や個人情報などが漏洩したりするなど、トラブルが発生している。そうした事態を防ぐためには、画像中に含まれるプライバシーに関係する情報を確実に加工して秘匿化することが重要だ。

しかし、画像の加工方法にはボカシやモザイク、または絵文字などを重ねるなど、複数の方法があるが、いずれの場合も目的の箇所を正確に秘匿化するには、AI機能などでは間に合わず、ユーザが直接編集を施す必要があることが多い。加えて、多くの手間を要する上に、それでもまだ秘匿が十分でないこともある。またこのような秘匿加工を施すと、元の画像と比べ、見た目の美しさや統一感を損なってしまうことも少なくなく、SNSなどで友人や仲間などと共有を目的とする場合などは特に望まれないこともある。そこで研究チームは今回、生成AI技術を用いて、プライバシーに関係する情報だけを、現実的に類似した代替の生成画像でシームレスに部分的に置き換える手法を開発することにしたという。

-

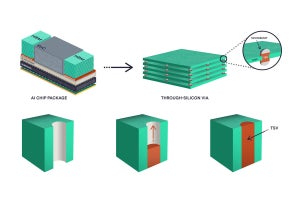

GCRの処理フロー。ユーザがアップロードした画像に対して、まず画像全体とプライバシーに関連しうる部分のテキストが生成される。それを元に、画像内のプライバシーに関連しうる部分に類似した代替画像が生成され、元画像上に配置することで、コンテンツの置換が行われる(出所:東大プレスリリースPDF)

今回開発されたGCR法では、まずユーザが加工したい画像をシステムにアップロードする。次にシステムは、マルチモーダル学習技術をベースに構築されたAI技術の「BLIP-2モデル」を用いて、アップロードされた画像全体の内容を表現するようなテキストを生成。さらに、矢谷准教授らが開発した、画像内においてプライバシーに関連しうる物体にアノテーションを施したデータセット「DIP」により提供されているマスク情報を用いて、画像内のプライバシーに関連しうる部分を抽出し、その部分の内容を表現するようなテキストを生成する。そして、この2つのテキストをもとに、拡散モデルと呼ばれる確率的プロセスを用い、テキストの記述に基づいて画像を生成するAI技術「Stable diffusion」(現在はバージョン2.1が使用されている)を用いて、画像内のプライバシーに関連しうる部分に類似した代替画像を生成し、元画像上に配置することで、コンテンツの置換を行う。これにより、元画像にあったプライバシーに関連しうる情報は秘匿化されながらも、画像の見た目や内容を維持することが可能となるという仕組みだ。

今回の研究では、ボカシ、カートゥーニング(画像の一部を非現実的な程度に強調する方法)、色塗り、除去(画像内のオブジェクトなどを消し去り、背景で置き換える)、GCRの5つを用いた比較実験が行われた。すると、GCRによる秘匿加工では、画像内で加工が行われた場所を見つけ出すことが最も難しかったことが確認されたという。また、ほかの秘匿加工手法と比較して、加工後の視覚的な調和が最も保たれていることも確認された。元画像が持つストーリー性の維持に関しては、GCRはカートゥーニングよりも劣ったものの、プライバシー保護の強さにおいてはGCRが秀でており、同手法による秘匿加工が、プライバシー保護と画像の視覚的美しさを両立しうる手法であることが確認されたとした。

-

GCRによる秘匿加工の一例。(上)後ろにいる男性が置換されている。左が元画像、右が加工後の画像。(下)前面にある車を維持しつつ、背景にある車やナンバープレートが置換されている。左が元画像、右が加工後の画像(出所:東大プレスリリースPDF)

今回の研究成果で、画像のプライバシー保護と有用性の両方が求められる応用において、実用的な生成AIの応用例が示されたが、今後SNSでの画像共有のほか、プレゼンテーションやビジュアルデザインへの応用も期待されるという。将来への展望として研究チームでは、一般的なユーザがより簡単にGCRを使用できるインタフェースの構築を進めているほか、動画への応用も検討しているとした。