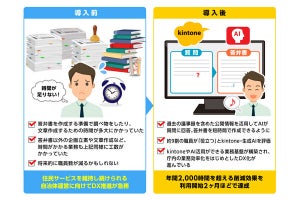

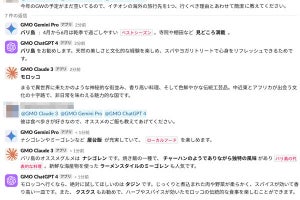

GMOインターネットグループは4月19日、生成AI(人工知能)の基盤となるクラウドインフラの提供に向けて、約100億円規模のGPUサーバーへの投資をすると発表した。2024年12月を目途に、米NVIDIAが提供する「NVIDIA H200 Tensor コア GPU(NVIDIA H200 GPU)」を採用したGPUクラウドサービスの国内提供を開始する。

同社は4月15日に経済安全保障推進法に基づく特定重要物資である「クラウドプログラム」の供給確保計画に関する経済産業省の認定を受けた。大規模言語モデルの開発・研究者向けにNVIDIA H200 GPUを約800基採用したGPUサーバーをクラウド環境で構築し、研究開発機関やスタートアップを始めとした法人などへ提供していく。

NVIDIA H200 GPUは、毎秒4.8テラバイトで141ギガバイトの「HBM3eメモリ」が備わっている。従来モデルの「NVIDIA H100 GPU」の約1.7倍の容量で、メモリ帯域幅は約1.4倍だ。この計算環境の構築に関わる設備投資額は、合計約100億円を見込んでいるといい、経済産業省からは最大19億2500万円の助成を受ける。

GMOインターネットグループ 代表取締役会長兼社長 グループ代表の熊谷正寿氏は、「国内AI産業の革新および拡大に向けて、より大きな一歩を踏み出す。AI時代のニーズに応える高品質なサービスを提供していく」とコメントしている。