英国規格協会(BSI:British Standards Institution)は、同協会が実施した「AI(人工知能)に対する信頼度調査」において61%がAI技術の国際的なガイドラインを望んでいるとの結果を受け、社会全体でAIを安全・安心、かつ責任をもって利用可能にするために策定された新しい管理システムの認証を含む、新たな対策パッケージを発表した。

AI対策パッケージの概要

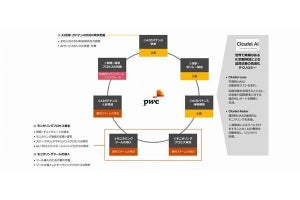

パッケージは、先日発表されたAIの国際的な管理システム規格(BS ISO/IEC 42001)に準拠。企業・組織が責任を持ってAIを利用することを支援し、不透明な自動意思決定、システム設計の際に人の手でコード化されたロジックではなく機械学習を活用すること、そして継続的な学習などの考慮事項に対処することを目的としている。

AIへの信頼を培うためBSIのAIサービスのポートフォリオを元に作成され、これには複雑なAI関連の標準や規制に対応するために必要な知識とスキルを個人・組織に提供するAIトレーニングコースなどが含まれている。

急速に進化する同分野では、AIが持つ倫理、法律、コンプライアンスの側面を理解することが責任ある持続可能な発展の実現に不可欠となっている。アルゴリズムテストは、AIシステムの信頼性、精度、性能に直接影響するため最も重要な要素となり、機械学習モデル、ディープニューラルネットワーク、自然言語処理などのAIアルゴリズムは、AIアプリケーションの意思決定プロセスを支えている。

BSIの厳格なテストは、これらのアルゴリズムの正確性と効率性の検証を行い、それらのAIが信頼できる結果を出し、実世界のシナリオに対して最適のパフォーマンスを出すことを確証するために不可欠なものだという。

また、自社のAI技術が責任を持って倫理的に使用されていることを確認する方法を必要としている組織向けに、AIエクセレンス・ベンチマーク・アセスメントを提供。アセスメントは組織に責任あるAIの実用を促進し、AIが普及した未来社会での成功に導くように設計されている。