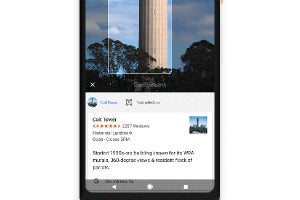

Googleが提供するビジュアル検索機能「Googleレンズ」を「カメラ」アプリを使ってリアルタイムで利用できるようになる。

Googleレンズは写真に写っているものを分析し、関連する情報を表示したり、文字をテキストデータに変換する。AR (拡張現実)のように見たままにビジュアル検索を行えると便利だが、これまではよりクラウドに近いGoogleフォトまたはGoogleアシスタントから利用するようになっていた。今回のアップデートで、Pixelシリーズの他、LG、Motorola、Xiaomi、Sony Mobile、HMD/Nokia、Transsion、TCL、OnePlus、BQ、Asusなどの対応デバイスで「カメラ」アプリから直接利用できるようになる。さらにカメラが捉えたものをその場で分析して情報表示するリアルタイム検索もサポートされ、AR感覚でGoogleレンズを利用できるようになる。

アップデートではまた、スマートテキスト選択 (smart text selection)との連動、「Style Match」が追加される。

スマートテキスト選択は、ユーザーが電話番号の数字を選択したら「電話」アプリがメニュー表示されるというように、選択した文字や数字に対応するアプリやサービスをスマートにリンクさせる機能。Googleレンズでは、印刷物にカメラを向け、Googleレンズが読み取った印刷物の文字や数字を選択すると検索が行われる。たとえば、料理名しか書かれていないレストランのメニューをGoogleレンズで見て、画面で料理名を選択すると、その料理の写真と説明のカードが現れるので、分からないメニューを次々に確認できる。

Style Matchは、ファッション関連やインテリア関連などで、特定のアイテムではなく、同じようなスタイルやデザイン、素材のアイテムを結果表示する。「こんな感じ」というような曖昧な検索ニーズに応える機能だ。